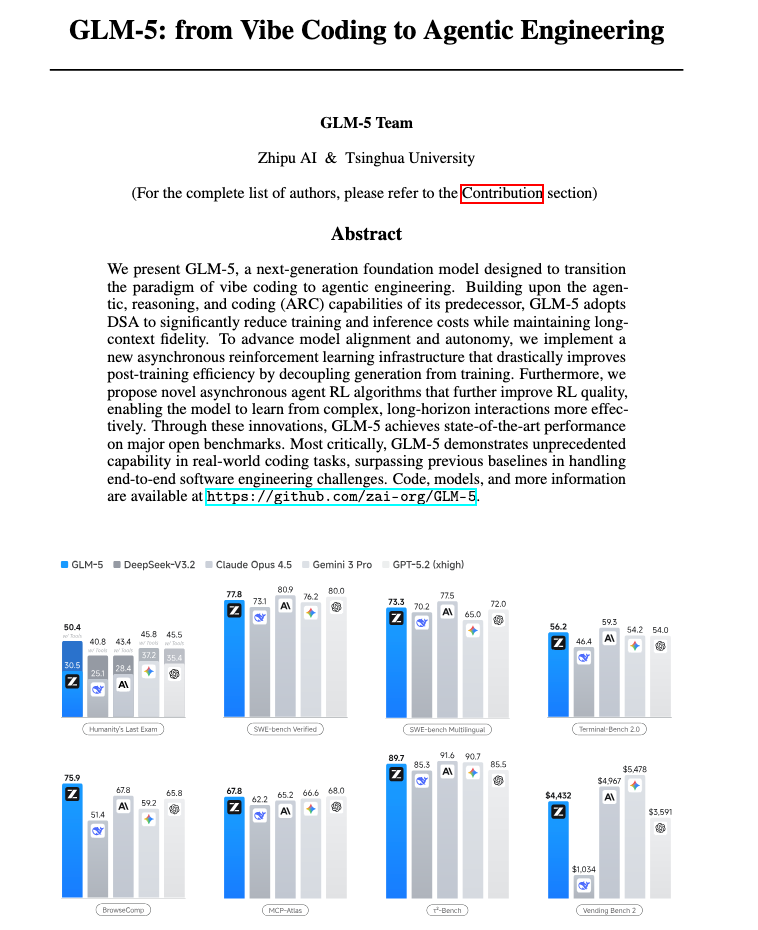

2月22日,“全球大模型第一股”智谱发布了最新一代基础模型GLM-5的技术报告,披露了GLM-5实现性能大幅跃升的技术细节。

GLM-5是一款旨在推动编程范式从“Vibe Coding”(氛围编程)转向“Agentic Engineering”(智能体工程)的下一代基础模型,其在编程能力与智能体能力上的表现出色。

据智谱介绍,GLM-5能够实现性能的大幅跃升,主要得益于以下四大技术创新:

第一、更高效的模型“大脑”。引入 DSA 稀疏注意力机制(DeepSeek Sparse Attention, DSA)。这一全新架构极大降低了训练与推理成本。此前的 GLM-4.5依赖标准 MoE 架构提升效率,而 DSA 机制则使 GLM-5能够根据 Token 的重要性动态分配注意力资源。在不折损上下文理解和推理深度的前提下,算力开销得以大幅削减。得益于此,智谱将模型参数规模成功扩展至744B(7440 亿),同时将训练 Token 规模提升至28.5T(28.5 万亿)。

第二、更快的“学习”方式。构建全新的异步 RL 基础设施。基于 GLM-4.5时期 slime 框架“训练与推理解耦”的设计,智谱的新基建进一步实现了“生成与训练”的深度解耦,将 GPU 利用率推向极致。该系统支持模型开展大规模的智能体(Agent)轨迹探索,大幅减缓了以往拖慢迭代速度的同步瓶颈,让 RL 后训练流程的效率实现了质的飞跃。

第三、更聪明的“决策”算法。提出全新的异步 Agent RL 算法。该算法旨在全面提升模型的自主决策质量。GLM-4.5曾依靠迭代自蒸馏和结果监督来训练 Agent;而在 GLM-5中,智谱研发的异步算法使模型能够从多样化的长周期交互中持续学习。这一算法针对动态环境下的规划与自我纠错能力进行了深度优化,这也正是 GLM-5能够在真实编程场景中表现卓越的底层逻辑。

第四、全面拥抱国产算力生态。从模型发布伊始,GLM-5就原生适配了中国 GPU 生态。智谱已完成从底层内核到上层推理框架的深度优化,全面兼容七大主流国产芯片平台:华为昇腾、摩尔线程、海光、寒武纪、昆仑芯、沐曦与燧原。

凭借上述进步,GLM-5不仅是一个更强大的模型,更是下一代 AI Agent 更高效、更实用的基础模型。智谱向社区开源 GLM-5,以进一步推动高效的、面向 Agent 的通用人工智能的发展。

上线仅几天,智谱以代号“Pony Alpha”就在顶级模型平台 OpenRouter 社区引发了轰动。开发者们敏锐地察觉到了它在处理复杂代码、Agent 任务链路及角色扮演时的卓越能力。初步统计显示,25%的用户推测它是 Anthropic 的 Claude Sonnet 5,20%认为是 Grok 的新版本,10%猜是 DeepSeek V4,而其余用户则成功猜中了 GLM-5。

“最终确认 Pony Alpha 真身即是 GLM-5,这对我们团队是一次巨大的鼓舞,也有力回击了长期以来外界对中国本土模型技术水准的质疑。”智谱表示。

智谱直言,Pony Alpha(GLM-5)不仅赢在了基准测试的榜单上,更赢在了真实场景里。这标志着其研发重心已深度转向“工程级可靠性”。这次匿名测试打破了先入为主的地缘政治偏见,让社区的认可回归到了“好用与否”这一最纯粹的技术本质。

智谱强调,开源追赶闭源的战役仍在继续,他们将坚定不移地探索技术前沿,构建更高效、更智能的底层系统。

文、图/广州日报新花城记者:张露

广州日报新花城编辑:李光曼