8月8日,在2025世界机器人大会主论坛上,宇树科技CEO王兴兴发表主题演讲。广州日报《机器人参考》记者现场直击,王兴兴深入剖析了当前机器人领域的技术瓶颈、行业误区及未来趋势,指出具身智能AI模型的不足是限制人形机器人大规模应用的核心问题,并分享了行业发展的关键方向与技术探索。

以下发言整理自他的部分演讲内容——

目前国内和海外的大公司,包括英伟达、苹果、Meta、OpenAI等,都在非常持续地推动具身智能和机器人领域的发展。我分享几个个人想法,未必准确。

观点:硬件够用,AI才是最大瓶颈

第一点,关于机器人本体,很多人有个误区,认为目前机器人没有大规模应用、功能不够完善,是因为硬件不够好或成本太高。其实最大的问题是,目前的硬件是够用的,某种意义上完全够用。人形机器人的硬件,哪怕是灵巧手、整机,某种意义上完全够用,当然还能做得更好。

要把硬件做得更好,更大的问题是量产,工程上的问题很多,但从技术层面或纯AI角度来说,目前的硬件完全够用。

而目前最大的挑战,是具身智能的AI完全不够用,这也是限制机器人,尤其人形机器人大规模应用的最大因素——机器人大模型或具身智能到现在还不太够用。

简单说,目前的情况有点像ChatGPT出来前的1到3年左右时间。整个业界已经发现了类似的方向及技术路线,但没人能把它做出来。大家知道,ChatGPT出来前的几年,语音AI已经发展了十几、二十年,但一直被认为很傻瓜,根本没法用。ChatGPT出来后,语音AI才达到性能更好的阶段。而机器人AI目前还没到这个临界点。

如果说机器人AI有临界点,会达到什么程度?就是哪一天我们带一个人形机器人到会场,它没见过这个会场,我们跟它说“帮忙把这瓶水带给某个观众”,它能比较顺畅地自己走过去,流畅地完成这件事;或者说“把这个房间帮忙整理一下”,它在完全没见过这个房间的情况下能自己完成,这就差不多达到了机器人的关键突破时刻。这个临界点,快的话未来2-3年很有可能实现,最慢估计3-5年也有很大概率实现,大家可以关注,但现在确实还没达到这个效果。

观点:模型问题远超数据问题

(那么目前具身智能领域)到底是模型的问题,还是数据的问题?我反而感觉目前全球范围内,大家对数据问题的关注度有点太高了。现在最大的问题其实是模型问题,而非数据问题。

在具身智能和机器人领域,整个模型架构不够好,也不够统一。所以模型问题其实现在大家关注得有点少,反而对数据问题关注过多。因为在大语言模型领域,大家觉得有足够多且好的数据,就能把模型训练得越来越好。但在具身智能和机器人领域,很多时候数据有了却用不起来,采了数据也不知道怎么用。

另外,大家知道目前比较火的VLA(视觉-语言-行动)模型是相对傻瓜式的架构。我个人对VLA模型还是比较怀疑的,因为对于VLA模型来说,它在与真实世界交互时,采集的数据质量不太够用。所以有个自然的想法,是在VLA模型上加RL训练,但我们公司目前尝试下来,感觉VLA模型加RL训练还是不够,模型架构还得升级和优化。

观点:视频生成模型或成新技术路径

这里分享一下我们过去做的事情。前几天谷歌发布了全新一代的视频生成模型,或者说某种意义上是视频驱动的世界模型,大家可以关注一下。去年OpenAI发布视频生成模型后,大家自然会想:如果控制视频生成模型,让它生成一个机器人整理房间的视频,要是视频里机器人能做好这件事,是不是能让视频生成模型直接驱动机器人去做?这个想法非常直接简单,所以我们去年就做了这个尝试。

大家能看到视频右上角有个小视频,那个视频是生成的,不是摄像头采集的。我们用预训练的视频生成模型重新训练,让它先生成机器人动作的视频,再控制机器人去做。这个技术是能实现的,谷歌的视频生成世界模型也想实现这个效果。我觉得这个路线比VLA模型更快,收敛的概率更大,但不敢打包票,因为还有很多问题。

其中一个大问题是视频生成模型太关注生成质量,导致GPU消耗大,而对机器人干活来说,不需要很高精度的视频生成质量,只要能驱动机器人干活就行。刚才提到的右上角视频是生成的,生成好后再控制机器人做事。大家有兴趣可以关注谷歌的视频生成模型,很有意思。这个模型架构非常简单粗暴,就是把机器人的动作序列控制直接对齐到整个模型架构。

另外一点,虽然目前机器人在跳舞、格斗等方面效果不错,但要进一步提升能力,机器人领域的scaling law(收放定律)做得非常不好。

举个简单例子,训练机器人动作时,有新舞蹈或新任务需要训练,每次都要重新开始。我们希望新训练能在老训练基础上进行,理论上每次训练速度能越来越快,学习新技能的效果越来越好,但全行业目前在机器人运动控制的scaling law上都没做好。这是非常值得做的方向,因为在语言模型上这已经被充分验证,但在机器人运动控制上才刚刚开始。在座同学可以关注这个领域,有望发表好论文。

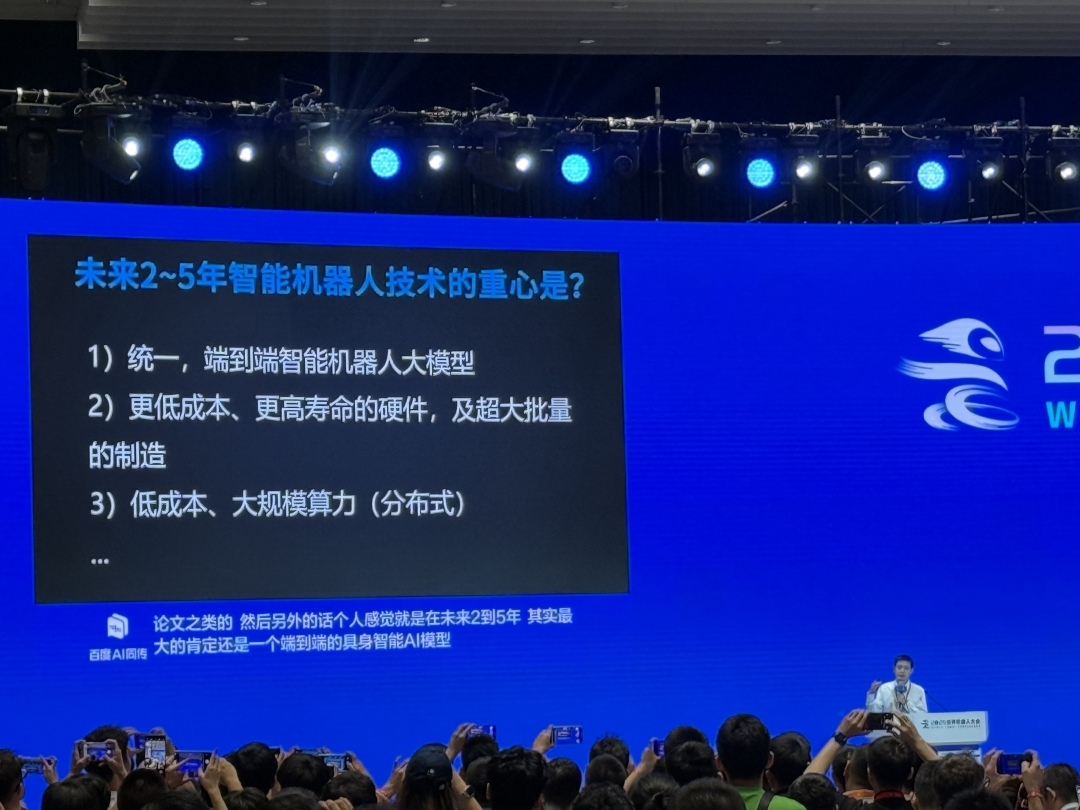

观点:模型、硬件与分布式算力是未来三大方向

个人感觉未来2-5年,最大的方向肯定是端到端的具身智能AI模型,这是大家要多关注和推动的最重要的事,模型本身非常关键。另外,更低成本、更高寿命的硬件也毋庸置疑。大家知道,汽车行业发展了100多年,现在要做出一辆好车,工程量依然很大。对于机器人行业来说,未来要生产几百万、几千万甚至几亿的人形机器人,工程挑战非常大。

还有低成本的大规模算力需求。在人形机器人或移动机器人本体上,没办法直接部署大规模算力,因为尺寸和电池限制了算力功耗。我个人感觉人形机器人最多只能部署峰值功耗约100瓦的算力,平时工作时最好只有小几十瓦,大概相当于几个手机的算力水平。但未来对大规模算力的需求是毋庸置疑的,而且可能是分布式算力。

因为机器人干活时通信延迟要低,如果北京的机器人连接上海或内蒙的算力中心,延迟太大。所以未来在工厂大规模应用时,比如一个工厂有100个机器人,可以在工厂设分布式服务器,所有机器人直接连接工厂的局部服务器,这样安全性和延迟都能接受。再比如小区里每家每户有机器人,小区或区域里肯定要有分布式集群算力中心,保证延迟和安全性,新客户买机器人也不用为算力建设花钱,成本更低。我觉得分布式算力是机器人领域未来非常重要的方向,比目前的算力分布更广。

观点:AI创新需全球协同共创

过去的AI领域包括机器人领域,都是全球共创的过程。中国企业、美国大企业在过去多年、当下及未来都做了很多贡献,共同推动这个领域发展。在机器人领域,一直是全球共创的。在AI领域,没有一家大公司能保证永远领先,OpenAI和DeepMind已经证明,AI创新永远伴随随机性,离不开聪明的年轻人。很多时候是每家公司和高校都做贡献,通过全球共创实现进步。

文、图/广州日报新花城记者:阮元元

广州日报新花城编辑:黎慧莹