只需输入简单的文字或图片描绘,一分钟左右,一条达到影视级视频就自动生成……9月24日,字节跳动正式宣告进军AI视频生成,旗下火山引擎正式发布豆包视频生成-PixelDance、豆包视频生成-Seaweed两款大模型。据悉,新款豆包视频生成模型正在即梦AI内测版小范围测试,未来将逐步开放给所有用户。当天,豆包大模型还发布了豆包音乐模型和同声传译模型,已全面覆盖语言、语音、图像、视频等全模态。

“视频大模型是最难的,需要大模型能理解复杂指令,包括对多镜头语言的运用,实现多个主题的交互视频,保持风格的一致性等。”火山引擎总裁谭待表示,当前视频生成仍有很多难关亟待突破。豆包两款模型会持续演进,在解决关键问题上探索更多可能性,加速拓展AI视频的创作空间和应用落地。

从现场展示的视频生成效果来看,无论是语义理解能力,多个主体运动的复杂交互画面,还是多镜头切换的内容一致性,豆包视频生成大模型均达到业界先进水平。谭待称,豆包视频生成大模型破解多主体互动和一致性难题,可以应用到许多商业场景。

此前视频生成模型大多只能完成简单指令,豆包视频生成模型则能实现自然连贯的多拍动作与多主体复杂交互。有创作者在抢鲜体验豆包视频生成模型时发现,其生成的视频不仅能够遵循复杂指令,让不同人物完成多个动作指令的互动,人物样貌、服装细节甚至头饰在不同运镜下也保持一致,接近实拍效果。

据介绍,豆包视频生成模型基于 DiT 架构,通过高效的DiT融合计算单元,让视频在大动态与运镜中自由切换,拥有变焦、环绕、平摇、缩放、目标跟随等多镜头语言能力。全新设计的扩散模型训练方法更是攻克了多镜头切换的一致性难题,在镜头切换时可同时保持主体、风格、氛围的一致性,这也是豆包视频生成模型独树一帜的技术创新。

经过剪映、即梦AI等业务场景打磨和持续迭代,豆包视频生成模型具备专业级光影布局和色彩调和,画面视觉极具美感和真实感。深度优化的Transformer结构,则大幅提升了豆包视频生成的泛化能力,支持3D动画、2D动画、国画、黑白、厚涂等多种风格,适配电影、电视、电脑、手机等各种设备的比例,不仅适用于电商营销、动画教育、城市文旅、微剧本等企业场景,也能为专业创作者和艺术家们提供创作辅助。

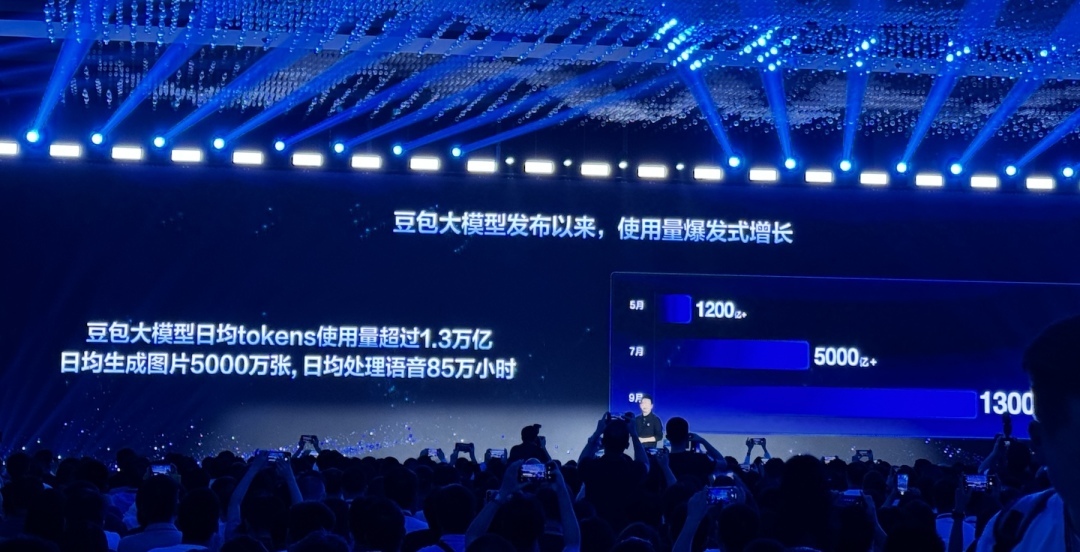

据火山引擎披露,豆包大模型的使用量实现在极速增长。截至9月,豆包语言模型的日均tokens使用量超过1.3万亿,相比5月首次发布时猛增十倍,多模态数据处理量也分别达到每天5000万张图片和85万小时语音。

与此同时,大模型成本也在进一步降低。谭待认为,成本已经不是大模型创新的阻碍,下一阶段要将大模型的性能大幅提升,随着企业大规模应用,大模型支持更大的并发流量正在成为行业发展的关键因素。“大模型要从卷价格走向卷性能,卷更好的模型能力和服务。”他表示,“业内多家大模型目前最高仅支持300K甚至100K的TPM(每分钟token数),难以承载企业生产环境流量。为此豆包大模型默认支持800K的初始TPM,远超行业平均水平,客户还可根据需求灵活扩容。”

文、图/广州日报新花城记者:邓莉

广州日报新花城编辑:龙嘉丽